9月27日,值国际聋人日之际,腾讯多媒体实验室联合腾讯公益慈善基金会、深圳市信息无障碍研究会等机构召开发布会,宣布发起“天籁行动”,面向公益开发者、设备厂商、相关机构开放腾讯天籁AI音频技术,应用于听障人群无障碍建设等相关社会责任领域。

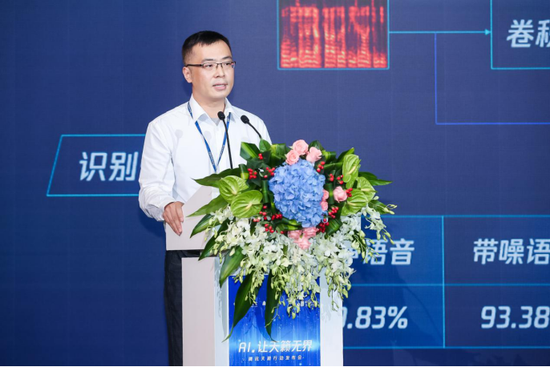

会上,腾讯多媒体实验室高级总监商世东发表了《AI,让天籁无界》的主题演讲,分享了腾讯天籁AI音频技术研发的原理及应用。

作为腾讯旗下顶尖的音视频通信和处理研发团队,腾讯多媒体实验室致力于实时音视频通信、音视频编解码前沿算法研究、音视频国际标准、计算机视觉图像处理、端到端音视频质量评测,天籁技术是其经验和技术能力积累的重要成果之一。

发布会现场,商世东与参会嘉宾分享了将天籁音频技术与人工耳蜗产品结合的源起。他表示,在与听障人群的多次接触中,他了解到虽然一些听障人群花高昂费用安装了人工耳蜗,但在机场、商场等比较嘈杂的公共环境中,依然面临着“听不清”的困扰。

基于此,腾讯多媒体实验室联合国内最大的人工耳蜗厂商之一——诺尔康(Nurotron)一起展开相关讨论和研究,经过长达半年的技术验证,从架构上最终确定了“手机伴侣+人工耳蜗”的联合解决方案,通过多种技术的优化和整合,实现了语音清晰度和可懂度提升40%的效果。经过提升后的信号,传递给人工耳蜗后,可以极大改善听障人士的听觉体验,让听障人士在“听得见”的基础上“听得清、听得真”。

商世东表示,未来,腾讯多媒体实验室将携手腾讯公益慈善基金会等团队,凝聚社会各界的技术志愿者,共同探索听障公益的数字化创新,与各方共同努力,推动实现社会的可持续发展。

腾讯多媒体实验室高级总监商世东

腾讯多媒体实验室高级总监商世东以下为商世东演讲实录:

尊敬的各位嘉宾,各位媒体朋友们,大家下午好。

我是腾讯多媒体实验室的高级总监商世东,再次感谢大家关注今天的新闻发布会。

为什么要做听障无障碍?要从我们实验室的背景说起。

作为腾讯公司前沿技术实验室之一,腾讯多媒体实验室专注音视频通信技术的前瞻性研究,工作需要和各种声音打交道;而在公司的一些无障碍项目交流当中,我们团队不止一次接触到听障人群。他们对声音的渴望,以及很多家庭为了孩子获得听的权利,付出了很多常人无法想象的努力,他们的坚持和努力,让人触动。

根据世界卫生组织(WHO)数据显示,全球有约11亿年轻人(12-35岁之间)面临听力损失的风险,约4.66亿人患有残疾性听力损失。据第二次全国残疾人抽样调查结果显示,我国有听力残疾患者2780万人。做为一名科技工作者,做为一个专注声音的研究团队,我们应该为他们做点什么?我们能为他们做点什么?这是我们团队讨论最多的问题。

于是,我们更进一步接触了听障人群中的人工耳蜗佩戴者,他们往往听力受损更加严重,有些人甚至是永久性听力损失,他们能接受到的声音能量和声音的细节都非常有限,现有的大部分人工耳蜗产品,他们在佩戴后,效果也往往不够理想。其中最严重,反映最为突出的就是噪声。而我们实验室,在噪声消除上,有多年的技术积累,在业界乃至国际上都保持着领先水平,在技术工程化、产品化上积累了丰富的经验。

这就是今天发布会的背景。

人工耳蜗虽然小,但是它面临的挑战巨大,可是它能利用的资源确非常的有限。当我们电脑,手机的CPU动则就有数GHz的运算能力的时候,人工耳蜗的核心处理器,用来进行音量控制和噪声消除的主要运算单元,却只有少的可怜的几十MHz。这样的运算能力只有电脑的几千分之一。在这样的硬件资源限制下,高计算复杂度的噪声处理成为了最大难点。一直以来,国内外都有一些团队和公司研究,但鲜有突破,效果总是不理想。

意识到这个是问题的症结所在之后,我们在今年年初找到了国内最大的人工耳蜗公司诺尔康,诺尔康是人工耳蜗的行业翘楚,我们一起讨论在当前人工耳蜗软硬件局限条件下的方案突破点在什么地方,有哪些选择,需要什么样的技术才能达成目标,等等。经过反反复复的讨论和来来回回的技术验证,我们从架构上最终确定了手机伴侣 + 人工耳蜗的联合解决方案。

在手机上,利用手机强大的处理能力,对采集到的语音信号进行预处理,在这样的处理过程,通过种种技术对语音进行增强,提升语音的清晰度和可懂度,然后把处理过后的干净语音,通过无线传输的方式送达到人工耳蜗,在人工耳蜗上进行二次加工,最后刺激人耳听觉神经,达到改善听觉的效果。从技术上,我们则确定了基于多场景识别的双麦降噪是我们的主攻方向。

在这期间,针对多音频场景技术,我们研发了基于ResNet深度残差网络的多级别,多输入尺度的场景识别技术来显著提高我们对人工耳蜗用户敏感的四种场景:干净语音,噪音,带噪语音,和音乐的识别。综合使用1by1的卷积核, 全局池化, MobileNet 中的多维度卷积等操作将深度神经网络轻量级化,保证识别方法适合低功耗的轻量级耳蜗场景识别终端;多尺度网络输入则保证有效区分不同声学场景频谱特征;多级别网络结构更加细化了易混淆场景(如噪音,低SNR带噪语音)。最终达到了96.2%的识别正确率,超过人工标注水平(约94.0%),有效的奠定了下一步的降噪和语音增强的效果。

针对噪声消除,我们进一步推进了经典算法和深度学习降噪的融合,语音增强算法分为经典降噪算法和基于深度学习的语音增强算法两大类。经典降噪算法计算复杂度相对较低且对平稳噪声具有良好的抑制能力,但对非平稳噪声和突发噪声,比如人群说话声和鼠标键盘敲击声,对这类噪声的处理能力较差。基于深度学习的语音增强算法利用其优秀的特征建模能力,对各种噪声进行建模,使得其可以很好地应对非平稳噪声,缺点是计算复杂度较高。智能语音增强算法是将两种算法进行了融合,使得我们的语音增强功能可以应对各种复杂的噪声场景。

经典降噪算法采用的倒谱均值减的算法,通过在非语音帧迭代更新噪声的方差,然后将噪声的方差从带噪语音信号的能量中减掉,即得到干净语音信号的估计。基于深度学习的语音增强算法是对带噪语音中干净语音所占比例(称为mask,掩码)进行估计,首先我们利用干净语音和采集到的各种类型的噪声构建带噪语音数据,然后通过计算干净语音和带噪语音计算真实的mask标签,接着通过神经网络训练得到估计的mask,接着根据相应的损失函数进行学习,最后得到训练好的语音增强模型。我们的方案不同点在于,为了减少复杂度,我们用了multi-task的方法进行多头辅助训练,但是只从一头输出干净语音,大大减少了模型参数量,在此基础上,我们通过对训练好的模型进行量化训练,使得我们的模型容量最终降至1M左右。

在这样的基础之上,进一步考虑到手机上已经有两个或者多个麦克风,我们快速研发了基于GSC广义旁瓣消除的beamforming波束形成技术,可以做到在完美保留1个目标方向的声音的同时,不但降低了传统意义上的噪声,而且对其它方向的干扰语音,音乐等也都可以达到20分贝以上的有效抑制,进一步的增强了听障人士对实际复杂环境的感知能力,从而提升了用户面对面交流的整体体验。

综上所述,通过多种技术的优化和整合,我们在手机上实现了语音清晰度和可懂度高达40%的提升,这样提升后的信号,传给人工耳蜗后,可以极大的改善听障人士的听觉体验,在原来借助传统人工耳蜗实现“听得见”基础上,可以帮助他们“听得清、听得真”。

以上,之所以能够达成这样的降噪效果,源自于腾讯的技术溢出,源自于腾讯多媒体实验室的多年技术积累,尤其是在多媒体技术方向上的锲而不舍的投入,我们过往20年开发的实时音频技术,过去用在腾讯QQ,腾讯游戏语音等大量产品,服务于全球最大体量用户。

最近的一个例子则是腾讯会议的实践。作为一款上线不到一年产品,腾讯会议的用户已经超过1亿,其快速增长的背后,就有腾讯“天籁”新一代实时音频技术的加持,致力于让用户在实时音视频会议时有更好的体验,解决实时音视频会议场景下的各种挑战;这一技术,就是腾讯天籁。下面,我们通过一个DEMO,让大家体验一下不同噪声环境下接入腾讯会议的体验。

今天,我们和诺尔康在人工耳蜗场景的合作和探索,或许只是一个开始;践行科技向善,是腾讯公司的使命和愿景。

在这里,我们也希望面向更多公益开发者、厂商、机构,开放腾讯天籁核心技术,希望借助腾讯公益基金会“科技公益互助计划”平台,联合更多致力于科技公益的合作伙伴,支持开展关注听障人群的社会责任公益实践,为信息无障碍社会构建贡献力量。

AI,让天籁无界。我们相信技术发展不仅可以提升社会生产效率,也可以助力信息无障碍建设,让每一个人都能够平等享受技术发展红利。

谢谢大家!

新浪公益频道致力于传播公益文化理念,创新公益模式,推动社会事业发展。

新浪公益

新浪公益 微公益

微公益 星光公益联盟

星光公益联盟 熊猫守护者

熊猫守护者 益起来

益起来 微环保

微环保